Распознавание жестов - Википедия - Gesture recognition

Эта статья тон или стиль могут не отражать энциклопедический тон используется в Википедии. (Ноябрь 2016) (Узнайте, как и когда удалить этот шаблон сообщения) |

Распознавание жеста это тема в Информатика и языковые технологии с целью интерпретации человеческих жесты через математический алгоритмы.[1] Жесты могут происходить из любого движения или состояния тела, но обычно происходят из лицо или же рука. Текущий[когда? ] фокусы в этой области включают распознавание эмоций от распознавания лиц и жестов рук. Пользователи могут использовать простые жесты для управления устройствами или взаимодействия с ними, не касаясь их физически. Многие подходы были сделаны с использованием камер и компьютерное зрение алгоритмы интерпретации язык знаков. Однако определение и распознавание позы, походки, проксемика, и человеческое поведение также является предметом методов распознавания жестов.[2]Распознавание жестов можно рассматривать как способ для компьютеров начать понимать человеческий язык тела, тем самым создавая более прочный мост между машинами и людьми, чем примитивные текстовые пользовательские интерфейсы или даже GUI (графические пользовательские интерфейсы), которые по-прежнему ограничивают большую часть ввода с клавиатуры и мыши и взаимодействуют естественным образом без каких-либо механических устройств. Используя концепцию распознавания жестов, можно указать пальцем, в этот момент он будет двигаться соответственно. Это может сделать обычный ввод на устройствах таким и даже избыточным.

Обзор

Особенности распознавания жестов:

- Более точным

- Высокая стабильность

- Экономия времени на разблокировку устройства

Основные области применения распознавания жестов в текущем[когда? ] сценарий:

- Автомобильный сектор

- Сектор бытовой электроники

- Транзитный сектор

- Игровой сектор

- Разблокировать смартфоны

- Защита[3]

- Домашняя автоматизация

- Автоматический перевод на язык жестов[4]

Распознавание жестов может быть выполнено с помощью техник из компьютерное зрение и обработка изображений.[5]

Литература включает текущую работу в области компьютерного зрения по улавливанию жестов или более общих человеческих поза и движения с помощью камер, подключенных к компьютеру.[6][7][8][9]

Распознавание жестов и перьевые вычисления:Перьевые вычисления уменьшают влияние оборудования на систему, а также расширяют диапазон объектов физического мира, которые можно использовать для управления, помимо традиционных цифровых объектов, таких как клавиатуры и мыши. Такие реализации могут позволить создать новый диапазон оборудования, для которого не требуются мониторы. Эта идея может привести к созданию голографического дисплея. Термин распознавание жестов используется для более узкого обозначения символов рукописного ввода без ввода текста, таких как рукописный ввод на графический планшет, мультитач жесты и жест мыши признание. Это взаимодействие с компьютером посредством рисования символов курсором указывающего устройства.[10][11][12] (видеть Ручные вычисления )

Типы жестов

В компьютерных интерфейсах различают два типа жестов:[13] Мы рассматриваем онлайн-жесты, которые также можно рассматривать как прямые манипуляции, такие как масштабирование и вращение. Напротив, офлайн-жесты обычно обрабатываются после завершения взаимодействия; е. грамм. нарисован круг, чтобы активировать контекстное меню.

- Офлайн-жесты: те жесты, которые обрабатываются после взаимодействия пользователя с объектом. Примером может служить жест для активации меню.

- Онлайн-жесты: жесты прямого управления. Они используются для масштабирования или поворота материального объекта.

Бесконтактный интерфейс

Бесконтактный пользовательский интерфейс - это новая технология, связанная с управлением жестами. Бесконтактный пользовательский интерфейс (TUI) это процесс управления компьютером с помощью движений тела и жестов без касания клавиатуры, мыши или экрана.[14] Бесконтактный интерфейс в дополнение к управлению жестами становится широко популярным, поскольку они предоставляют возможность взаимодействовать с устройствами, не касаясь их физически.

Типы бесконтактных технологий

Существует ряд устройств, использующих этот тип интерфейса, например смартфоны, ноутбуки, игры, телевидение и музыкальное оборудование.

Один из типов бесконтактного интерфейса использует подключение смартфона по Bluetooth для активации системы управления посетителями компании. Это избавляет от необходимости прикасаться к интерфейсу во время COVID-19 пандемия.[15]

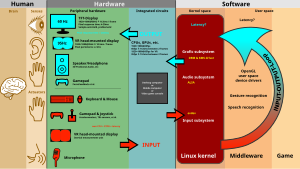

Устройства ввода

Способность отслеживать движения человека и определять, какие жесты они могут выполнять, может быть достигнута с помощью различных инструментов. Кинетические пользовательские интерфейсы (KUI)[16] являются новым типом пользовательские интерфейсы которые позволяют пользователям взаимодействовать с вычислительными устройствами посредством движения объектов и тел. Примеры KUI включают: осязаемые пользовательские интерфейсы и игры с движением, такие как Wii и Microsoft Kinect, и другие интерактивные проекты.[17]

Несмотря на то, что в области распознавания жестов на основе изображений / видео было проведено большое количество исследований, существуют некоторые различия в инструментах и средах, используемых между реализациями.

- Проволочные перчатки. Они могут обеспечивать ввод в компьютер информации о положении и вращении рук с использованием магнитных или инерциальных устройств слежения. Кроме того, некоторые перчатки могут обнаруживать сгибание пальцев с высокой степенью точности (5-10 градусов) или даже обеспечивать тактильную обратную связь с пользователем, которая является имитацией осязания. Первым коммерчески доступным перчаточным устройством для отслеживания рук было устройство DataGlove,[18] устройство перчаточного типа, которое могло определять положение руки, движение и сгибание пальцев. Для этого используются оптоволоконные кабели, идущие по тыльной стороне ладони. Создаются световые импульсы, и когда пальцы сгибаются, свет просачивается через небольшие трещины, и регистрируется потеря, что дает приблизительное представление о позе руки.

- Камеры с функцией определения глубины. Использование специализированных камер, таких как структурированный свет или же времяпролетные камеры, можно создать карта глубины того, что видно через камеру с близкого расстояния, и используйте эти данные для приблизительного трехмерного представления того, что видно. Они могут быть эффективны для обнаружения жестов рук из-за их короткого действия.[19]

- Стерео камеры. Используя две камеры, отношение которых друг к другу известно, можно аппроксимировать трехмерное представление по выходным сигналам камер. Чтобы получить взаимосвязь камер, можно использовать ссылку позиционирования, такую как лексическая полоса или же инфракрасный излучатели.[20] В сочетании с прямым измерением движения (6D-зрение ) жесты могут быть обнаружены напрямую.

- Контроллеры на основе жестов. Эти контроллеры действуют как продолжение тела, поэтому при выполнении жестов часть их движения может быть удобно зафиксирована программным обеспечением. Пример зарождающейся жестовой захвата движения через скелет отслеживание рук, который разрабатывается для приложений виртуальной и дополненной реальности. Пример этой технологии демонстрируют трекинговые компании. uSens и Гестигон, которые позволяют пользователям взаимодействовать со своим окружением без контроллеров.[21][22]

Другой пример этого: отслеживание жестов мыши, где движение мыши соотносится с символом, нарисованным рукой человека, который может изучать изменения ускорения с течением времени для представления жестов.[23][24][25] Программное обеспечение также компенсирует тремор человека и непреднамеренное движение.[26][27][28] Датчики этих интеллектуальных светоизлучающих кубов могут использоваться для обнаружения рук и пальцев, а также других объектов поблизости и могут использоваться для обработки данных. Большинство приложений находятся в музыке и синтезе звука,[29] но может применяться и к другим полям.

- Одиночная камера. Стандартная 2D-камера может использоваться для распознавания жестов, если ресурсы / среда не подходят для других форм распознавания на основе изображений. Ранее считалось, что одиночная камера может быть не так эффективна, как стереокамера или камеры с функцией определения глубины, но некоторые компании оспаривают эту теорию. Технология распознавания жестов на основе программного обеспечения с использованием стандартной 2D-камеры, которая может обнаруживать надежные жесты рук.

Алгоритмы

В зависимости от типа входных данных подход к интерпретации жеста может быть различным. Однако большинство методов полагаются на ключевые указатели, представленные в трехмерной системе координат. На основе их относительного движения жест может быть обнаружен с высокой точностью, в зависимости от качества ввода и подхода алгоритма.

Чтобы интерпретировать движения тела, нужно классифицировать их по общим свойствам и сообщениям, которые движения могут выражать. Например, на языке жестов каждый жест представляет собой слово или фразу.

В некоторой литературе различают 2 разных подхода к распознаванию жестов: на основе 3D-модели и на основе внешнего вида.[30] Самый передовой метод использует трехмерную информацию о ключевых элементах частей тела, чтобы получить несколько важных параметров, таких как положение ладони или углы суставов. С другой стороны, системы на основе внешнего вида используют изображения или видео для прямой интерпретации.

Алгоритмы на основе 3D-моделей

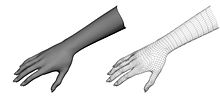

Подход 3D-модели может использовать объемные или скелетные модели, или даже их комбинацию. Объемные подходы широко используются в индустрии компьютерной анимации и для целей компьютерного зрения. Модели обычно создаются из сложных трехмерных поверхностей, таких как NURBS или полигональные сетки.

Недостатком этого метода является то, что он требует больших вычислительных ресурсов, а системы для анализа в реальном времени еще не разработаны. На данный момент более интересным подходом было бы сопоставление простых примитивных объектов с наиболее важными частями тела человека (например, цилиндры для рук и шеи, сфера для головы) и анализ того, как они взаимодействуют друг с другом. Кроме того, некоторые абстрактные структуры, такие как супер-квадрики и обобщенные цилиндры может быть даже более подходящим для аппроксимации частей тела.

Скелетные алгоритмы

Вместо интенсивной обработки 3D-моделей и работы с множеством параметров можно просто использовать упрощенную версию параметров угла сочленения вместе с длинами сегментов. Это известно как скелетное представление тела, где вычисляется виртуальный скелет человека и части тела сопоставляются с определенными сегментами. Анализ здесь выполняется с использованием положения и ориентации этих сегментов и отношения между каждым из них (например, угла между суставами и относительного положения или ориентации).

Преимущества использования скелетных моделей:

- Алгоритмы работают быстрее, потому что анализируются только ключевые параметры.

- Возможно сопоставление шаблонов с базой данных шаблонов

- Использование ключевых точек позволяет программе обнаружения сосредоточиться на значительных частях тела.

Модели на основе внешнего вида

Эти модели больше не используют пространственное представление тела, потому что они получают параметры непосредственно из изображений или видео с использованием базы данных шаблонов. Некоторые из них основаны на деформируемых 2D-шаблонах частей тела человека, особенно рук. Деформируемые шаблоны - это наборы точек на контуре объекта, используемые в качестве узлов интерполяции для аппроксимации контура объекта. Одна из простейших функций интерполяции - линейная, которая выполняет усреднение формы из наборов точек, параметров изменчивости точек и внешних деформаторов. Эти модели на основе шаблонов в основном используются для отслеживания рук, но также могут быть полезны для простой классификации жестов.

Второй подход к обнаружению жестов с использованием моделей на основе внешнего вида использует последовательности изображений в качестве шаблонов жестов. Параметрами для этого метода являются либо сами изображения, либо определенные на их основе функции. В большинстве случаев используются только один (моноскопический) или два (стереоскопический) вид.

Электромиографические модели

Электромиография (ЭМГ) касается изучения электрических сигналов, производимых мышцами тела. Посредством классификации данных, полученных от мышц руки, можно классифицировать действие и, таким образом, ввести жест во внешнее программное обеспечение.[1] Потребительские устройства ЭМГ позволяют использовать неинвазивные методы, такие как повязка на руку или ногу, и подключаются через Bluetooth. Благодаря этому у ЭМГ есть преимущество перед визуальными методами, поскольку пользователю не нужно смотреть в камеру для ввода данных, что обеспечивает большую свободу движений.

Вызовы

Есть много проблем, связанных с точностью и полезностью программного обеспечения для распознавания жестов. Для распознавания жестов на основе изображений существуют ограничения на используемое оборудование и шум изображения. Изображения или видео могут быть не при постоянном освещении или в одном месте. Предметы на заднем плане или отличительные особенности пользователей могут затруднить распознавание.

Разнообразие реализаций распознавания жестов на основе изображений также может вызвать проблемы с жизнеспособностью технологии для общего использования. Например, алгоритм, откалиброванный для одной камеры, может не работать для другой камеры. Уровень фонового шума также вызывает трудности с отслеживанием и распознаванием, особенно при возникновении окклюзии (частичной и полной). Кроме того, расстояние до камеры, ее разрешение и качество также влияют на точность распознавания.

Чтобы улавливать жесты человека с помощью визуальных датчиков, также требуются надежные методы компьютерного зрения, например, для отслеживания рук и распознавания положения рук.[31][32][33][34][35][36][37][38][39] или для фиксации движений головы, мимики или направления взгляда.

Социальная приемлемость

Одна из серьезных проблем, связанных с внедрением жестовых интерфейсов на потребительские мобильные устройства, такие как смартфоны и умные часы, связана с тем, что жесты вводятся с социальной приемлемостью. Хотя жесты могут способствовать быстрому и точному вводу на многих компьютерах с новым форм-фактором, их внедрение и полезность часто ограничиваются социальными факторами, а не техническими. С этой целью разработчики методов ввода с помощью жестов могут стремиться уравновесить как технические соображения, так и готовность пользователя выполнять жесты в различных социальных контекстах.[40] Кроме того, различное оборудование устройства и механизмы распознавания поддерживают различные типы распознаваемых жестов.

Мобильное устройство

Интерфейсы жестов на мобильных устройствах и устройствах малого форм-фактора часто поддерживаются наличием датчиков движения, таких как инерциальные единицы измерения (Я должен). На этих устройствах распознавание жестов полагается на то, что пользователи выполняют жесты на основе движений, которые могут быть распознаны этими датчиками движения. Это потенциально может затруднить захват сигнала от незаметных жестов или жестов с низким движением, поскольку их может быть трудно отличить от естественных движений или шума. В ходе опроса и изучения юзабилити жестов исследователи обнаружили, что жесты, которые включают в себя легкие движения, которые кажутся похожими на существующие технологии, выглядят или ощущаются одинаковыми для всех действий и которые доставляют удовольствие, с большей вероятностью будут приняты пользователями, в то время как жесты, которые выглядят странно, неудобно выполнять, мешает общению или предполагает необычное движение, из-за которого пользователи с большей вероятностью откажутся от их использования.[40] Социальная приемлемость жестов на мобильных устройствах во многом зависит от естественности жеста и социального контекста.

Накладные и переносные компьютеры

Носимые компьютеры обычно отличаются от традиционных мобильные устройства в том, что их использование и взаимодействие происходит на теле пользователя. В этих контекстах интерфейсы жестов могут стать предпочтительнее традиционных методов ввода, поскольку их малый размер сенсорные экраны или же клавиатуры менее привлекательно. Тем не менее, когда дело доходит до жестового взаимодействия, они сталкиваются с теми же проблемами социальной приемлемости, что и мобильные устройства. Однако возможность скрытия носимых компьютеров от глаз или их интеграции с другими повседневными предметами, такими как одежда, позволяет вводить жесты для имитации обычных взаимодействий с одеждой, таких как регулировка воротника рубашки или потирание переднего кармана брюк.[41][42] Основным фактором при взаимодействии с носимым компьютером является место размещения устройства и взаимодействия с ним. Исследование отношения сторонних организаций к взаимодействию с носимыми устройствами, проведенное в Соединенные Штаты и Южная Корея обнаружили различия в восприятии использования носимых компьютеров мужчинами и женщинами, отчасти из-за того, что разные участки тела считаются социально уязвимыми.[42] Другое исследование, посвященное социальной приемлемости проецируемых на тело интерфейсов, показало аналогичные результаты: в обоих исследованиях области вокруг талии, паха и верхней части тела (для женщин) были обозначены как наименее приемлемые, а области вокруг предплечья и запястья - как наиболее приемлемые.[43]

Общественные установки

Общественные установки, такие как интерактивные публичные дисплеи, позволяют получить доступ к информации и отображать интерактивные медиа в общественных местах, таких как музеи, галереи и театры.[44] В то время как сенсорные экраны являются частой формой ввода для общедоступных дисплеев, интерфейсы жестов обеспечивают дополнительные преимущества, такие как улучшенная гигиена, взаимодействие на расстоянии, улучшенная видимость и могут способствовать перформативному взаимодействию.[41] Важным моментом при жестовом взаимодействии с публичными дисплеями является высокая вероятность или ожидания зрительской аудитории.[44]

"Рука гориллы"

«Рука гориллы» была побочным эффектом использования вертикально ориентированного сенсорного экрана или светового пера. В периоды длительного использования руки пользователей начинали чувствовать усталость и / или дискомфорт. Этот эффект способствовал упадку сенсорного ввода, несмотря на первоначальную популярность в 1980-х годах.[45][46]

Чтобы измерить утомляемость руки и побочный эффект руки гориллы, исследователи разработали метод, названный Consumed Endurance.[47][48]

Смотрите также

- Распознавание активности

- Оценка позы шарнирного тела

- Автомобильное головное устройство

- Компьютерная обработка языка тела

- Оценка позы в 3D

- Указывающий жест устройства

Рекомендации

- ^ а б Кобыларз, Джонатан; Bird, Jordan J .; Faria, Diego R .; Рибейро, Эдуардо Паренте; Экарт, Анико (07.03.2020). «Недурно: невербальное взаимодействие человека и робота через классификацию ЭМГ в реальном времени с помощью индуктивного трансдуктивного обучения с учителем». Журнал окружающего интеллекта и гуманизированных вычислений. ООО "Спрингер Сайенс энд Бизнес Медиа". Дои:10.1007 / s12652-020-01852-z. ISSN 1868-5137.

- ^ Матиас Рем, Николаус Би, Элизабет Андре, Волна как египтянин - распознавание жестов на основе акселерометра для взаимодействия с культурой, Британское компьютерное общество, 2007 г.

- ^ "Отчет о патентном ландшафте Распознавание жестов рук PatSeer Pro". PatSeer. Получено 2017-11-02.

- ^ Чай, Сюцзюань и др. "Распознавание языка жестов и перевод с помощью kinect. »IEEE Conf. On AFGR. Vol. 655. 2013.

- ^ Султана А, Раджапуша Т. (2012), «Распознавание жестов по алфавиту с использованием классификатора SVM», Международный журнал компьютерных наук и инженерных технологий (IJCSET)., 2012

- ^ Павлович В., Шарма Р. и Хуанг Т. (1997), «Визуальная интерпретация жестов рук для взаимодействия человека с компьютером: обзор», IEEE Transactions on Pattern Analysis and Machine Intelligence, июль 1997 г. Vol. 19 (7), стр. 677-695.

- ^ Р. Чиполла и А. Пентланд, Компьютерное зрение для взаимодействия человека с машиной, Cambridge University Press, 1998 г., ISBN 978-0-521-62253-0

- ^ Инь Ву и Томас С. Хуанг,«Распознавание жестов на основе зрения: обзор» В архиве 2011-08-25 на Wayback Machine, В: Общение на основе жестов во взаимодействии человека и компьютера, том 1739 лекций Springer по информатике, страницы 103-115, 1999, ISBN 978-3-540-66935-7, Дои:10.1007/3-540-46616-9

- ^ Алехандро Хаймес и Нику Себе,Мультимодальное взаимодействие человека с компьютером: обзор В архиве 2011-06-06 на Wayback Machine, Компьютерное зрение и понимание изображений, том 108, выпуски 1-2, октябрь – ноябрь 2007 г., страницы 116-134, специальный выпуск о зрении для взаимодействия человека и компьютера, Дои:10.1016 / j.cviu.2006.10.019

- ^ Доперчук Олег; «Распознавание жестов почерка», gamedev.net, 9 января 2004 г.

- ^ Чен, Шицзе; «Методы распознавания жестов в приложении для распознавания рукописного ввода», Границы распознавания почерка с. 142-147 ноябрь 2010 г.

- ^ Balaji, R; Deepu, V; Мадхванатх, Шриганеш; Прабхакаран, Джаяшри «Распознавание рукописных жестов для жестовой клавиатуры» В архиве 2008-09-06 на Wayback Machine, Лаборатории Hewlett-Packard

- ^ Дитрих Каммер, Мэнди Кек, Георг Фрайтаг, Маркус Вакер, Таксономия и обзор платформ Multi-Touch: архитектура, объем и функции В архиве 2011-01-25 на Wayback Machine

- ^ "определение бесконтактного пользовательского интерфейса из энциклопедии журнала PC". pcmag.com. Получено 2017-07-28.

- ^ «Как COVID 19 может изменить способ работы людей с приложениями для входа в систему». 22 мая 2020.

- ^ В. Паллотта; П. Брейггер; Б. Хирсбруннер (февраль 2008 г.). «Кинетические пользовательские интерфейсы: физическое воплощение взаимодействия с повсеместными мобильными вычислительными системами». Достижения в области повсеместных вычислений: будущие парадигмы и направления. Издательство IGI.

- ^ С. Бенфорд; Х. Шнадельбах; Б. Колева; Б. Гавер; А. Шмидт; А. Буше; А. Стид; Р. Анастаси; К. Гринхалг; Т. Родден; Х. Геллерсен (2003). «Разумно, разумно и желательно: основа для проектирования физических интерфейсов» (PDF). CiteSeerX 10.1.1.190.2504. Архивировано из оригинал (PDF) 26 января 2006 г. Цитировать журнал требует

| журнал =(помощь) - ^ Томас Г. Циммерман, Джарон Ланье, Чак Бланшар, Стив Брайсон и Янг Харвилл. http://portal.acm.org. "УСТРОЙСТВО ИНТЕРФЕЙСА РУЧНОГО ЖЕСТА." http://portal.acm.org.

- ^ Ян Лю, Юнде Цзя, Надежный метод отслеживания рук и распознавания жестов для носимых визуальных интерфейсов и их приложений, Труды Третьей Международной конференции по изображению и графике (ICIG’04), 2004 г.

- ^ Куэ-Бом Ли, Чон-Хён Ким, Кван-Сок Хон, Реализация мультимодального игрового интерфейса на базе КПК, Пятая международная конференция по исследованиям, управлению и приложениям программной инженерии, 2007 г.

- ^ "Отслеживание жестов Гестигона - нарушение TechCrunch". TechCrunch. Получено 11 октября 2016.

- ^ Матни, Лукас. «uSens демонстрирует новые датчики слежения, которые призваны обеспечить более богатые возможности мобильной виртуальной реальности». TechCrunch. Получено 29 августа 2016.

- ^ Пер Мальместиг, Софи Сундберг, SignWiiver - реализация технологии жестового языка В архиве 2008-12-25 на Wayback Machine

- ^ Томас Шломер, Бенджамин Поппинга, Нильс Хенце, Сюзанна Болл, Распознавание жестов с помощью контроллера Wii, Материалы 2-й международной конференции по материальному и встроенному взаимодействию, 2008 г.

- ^ AiLive Inc., Белая книга LiveMove В архиве 2007-07-13 на Wayback Machine, 2006

- ^ Электронный дизайн 8 сентября 2011 года. Уильям Вонг. Естественный пользовательский интерфейс использует интеграцию датчиков.

- ^ Cable & Satellite International Сентябрь / октябрь 2011 г. Стивен Казинс. Взгляд к острым ощущениям.

- ^ TechJournal Юг 7 января 2008 г. Hillcrest Labs объявляет раунд на 25 миллионов долларов.

- ^ Блог Percussa AudioCubes 4 октября 2012 г. Жестовой контроль в синтезе звука. В архиве 2015-09-10 на Wayback Machine

- ^ Владимир И. Павлович, Раджив Шарма, Томас С. Хуанг, Визуальная интерпретация жестов рук для взаимодействия человека с компьютером; Обзор, IEEE Transactions on Pattern Analysis and Machine Intelligence, 1997

- ^ Иван Лаптев и Тони Линдеберг «Отслеживание моделей рук с несколькими состояниями с использованием фильтрации частиц и иерархии функций многомасштабных изображений», Proceedings Scale-Space and Morphology in Computer Vision, Volume 2106 of Springer Lecture Notes in Computer Science, страницы 63-74, Ванкувер, Британская Колумбия, 1999. ISBN 978-3-540-42317-1, Дои:10.1007/3-540-47778-0

- ^ фон Харденберг, Кристиан; Берар, Франсуа (2001). «Взаимодействие человека с компьютером голыми руками». Материалы семинара 2001 г. по перцептивным пользовательским интерфейсам. Сборник материалов международной конференции ACM. 15 архив. Орландо, Флорида. С. 1–8. CiteSeerX 10.1.1.23.4541.

- ^ Ларс Бретцнер, Иван Лаптев, Тони Линдеберг «Распознавание жестов рук с использованием многомасштабных цветовых функций, иерархических моделей и фильтрации частиц», Материалы пятой Международной конференции IEEE по автоматическому распознаванию лиц и жестов, Вашингтон, округ Колумбия, США, 21–21 мая 2002 г., страницы 423–428. ISBN 0-7695-1602-5, Дои:10.1109 / AFGR.2002.1004190

- ^ Домитилла дель Веккьо, Ричард М. Мюррей Пьетро Перона, «Разложение человеческого движения на динамические примитивы с применением к задачам рисования» В архиве 02.02.2010 в Wayback Machine, AutomaticaVolume 39, выпуск 12, декабрь 2003 г., страницы 2085–2098, Дои:10.1016 / S0005-1098 (03) 00250-4.

- ^ Томас Б. Меслунд и Лау Норгаард, «Краткий обзор жестов рук, используемых в носимых интерфейсах человек-компьютер» В архиве 2011-07-19 в Wayback Machine, Технический отчет: CVMT 03-02, ISSN 1601-3646, Лаборатория компьютерного зрения и медиа-технологий, Университет Ольборга, Дания.

- ^ М. Кольш и М. Тюрк «Быстрое двухмерное отслеживание рук со множеством функций и интеграцией нескольких сигналов» В архиве 2008-08-21 на Wayback Machine, CVPRW '04.Труды Семинар по компьютерному зрению и распознаванию образов, 27 мая - 2 июня 2004 г., Дои:10.1109 / CVPR.2004.71

- ^ Ся Лю Фуджимура, К., «Распознавание жестов руки с использованием данных глубины», Труды Шестой Международной конференции IEEE по автоматическому распознаванию лиц и жестов, 17–19 мая 2004 г., страницы 529-534, ISBN 0-7695-2122-3, Дои:10.1109 / AFGR.2004.1301587.

- ^ Стенджер Б., Таянантан А., Торр PH, Чиполла Р.: «Отслеживание рук на основе модели с использованием иерархического байесовского фильтра», IEEE Transactions on IEEE Transactions on Pattern Analysis and Machine Intelligence, 28 (9): 1372-84, сентябрь 2006 г.

- ^ Эрол, Дж. Бебис, М. Николеску, Р. Д. Бойл, Х Твомбли, «Оценка позы руки на основе зрения: обзор», Компьютерное зрение и понимание изображений, том 108, выпуски 1-2, октябрь – ноябрь 2007 г., страницы 52-73, специальный выпуск о зрении для взаимодействия человека и компьютера, Дои:10.1016 / j.cviu.2006.10.012.

- ^ а б Рико, Джули; Брюстер, Стивен (2010). «Используемые жесты для мобильных интерфейсов: оценка социальной приемлемости». Материалы конференции SIGCHI по человеческому фактору в вычислительных системах. ЧИ '10. Нью-Йорк, Нью-Йорк, США: ACM: 887–896. Дои:10.1145/1753326.1753458. ISBN 9781605589299. S2CID 16118067.

- ^ а б Уолтер, Роберт; Байи, Жиль; Мюллер, Йорг (2013). «StrikeAPose: демонстрация жестов в воздухе на публичных дисплеях». StrikeAPose. Материалы конференции SIGCHI по человеческому фактору в вычислительных системах - CHI '13. Нью-Йорк, Нью-Йорк, США: ACM Press. С. 841–850. Дои:10.1145/2470654.2470774. ISBN 9781450318990. S2CID 2041073.

- ^ а б Profita, Halley P .; Клоусон, Джеймс; Гиллиланд, Скотт; Зиглер, Клинт; Старнер, Тад; Бадд, Джим; До, Эллен Йи-Луен (2013). «Не обращай внимания на мое запястье: пример взаимодействия с телесными технологиями в общественных местах». Материалы Международного симпозиума по носимым компьютерам 2013 г.. ISWC '13. Нью-Йорк, Нью-Йорк, США: ACM: 89–96. Дои:10.1145/2493988.2494331. ISBN 9781450321273. S2CID 3236927.

- ^ Харрисон, Крис; Фасте, Хокон (2014). «Последствия местоположения и касания для проецируемых на теле интерфейсов». Материалы конференции 2014 г. по проектированию интерактивных систем. DIS '14. Нью-Йорк, Нью-Йорк, США: ACM: 543–552. Дои:10.1145/2598510.2598587. ISBN 9781450329026. S2CID 1121501.

- ^ а б Ривз, Стюарт; Бенфорд, Стив; О'Мэлли, Клэр; Фрейзер, Майк (2005). «Создание зрительского опыта» (PDF). Материалы конференции SIGCHI по человеческому фактору в вычислительных системах - CHI '05. Нью-Йорк, Нью-Йорк, США: ACM Press: 741. Дои:10.1145/1054972.1055074. ISBN 978-1581139983. S2CID 5739231.

- ^ Руперт Гудвинс. «Windows 7? В ней нет руки». ZDNet.

- ^ "рука гориллы". catb.org.

- ^ Hincapié-Ramos, J.D., Guo, X., Moghadasian, P. and Irani. С. 2014. «Потребляемая выносливость: показатель для количественной оценки утомляемости рук при взаимодействии в воздухе». В материалах 32-й ежегодной конференции ACM по человеческому фактору в вычислительных системах (CHI '14). ACM, Нью-Йорк, Нью-Йорк, США, 1063–1072. DOI = 10.1145 / 2556288.2557130

- ^ Хинкапи-Рамос, Дж. Д., Го, X., Ирани, П., 2014. «Верстак Consumed Endurance Workbench: инструмент для оценки утомляемости рук во время взаимодействия в воздухе». В материалах сопутствующей публикации 2014 г. «Проектирование интерактивных систем» (DIS Companion '14). ACM, Нью-Йорк, штат Нью-Йорк, США, 109-112. DOI = 10.1145 / 2598784.2602795

внешняя ссылка

- Аннотированная библиография ссылок на жесты и перьевые вычисления

- Заметки по истории перьевых вычислений (YouTube)

- Будущее, это все жест —Жестовые интерфейсы и видеоигры

- Жестовая интерактивная реклама Форда - Жесты, используемые для взаимодействия с цифровыми табло.

- 3D отслеживание рук —Обзор литературы